West Indies France : découvrir les Antilles françaises en profondeur

/

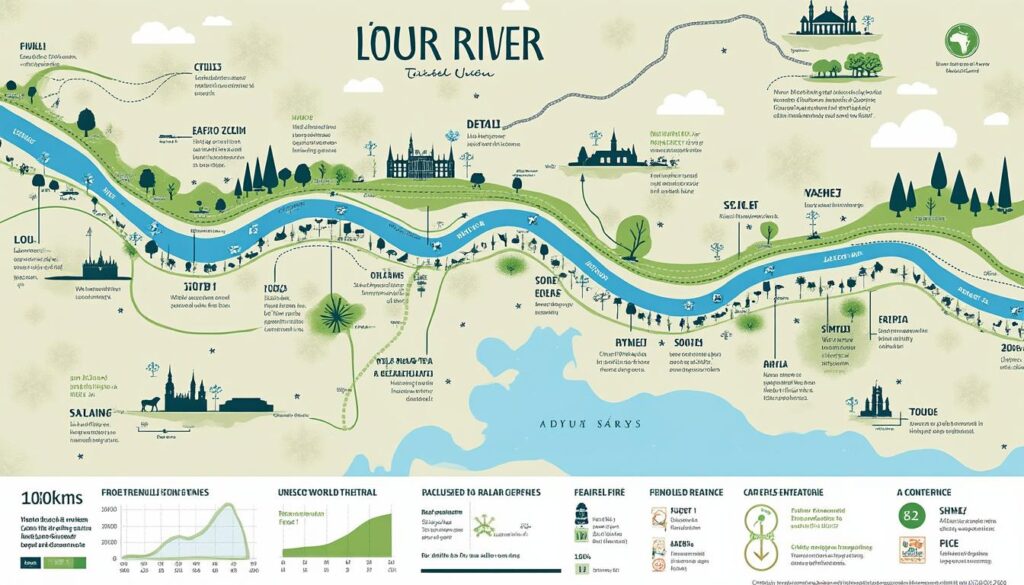

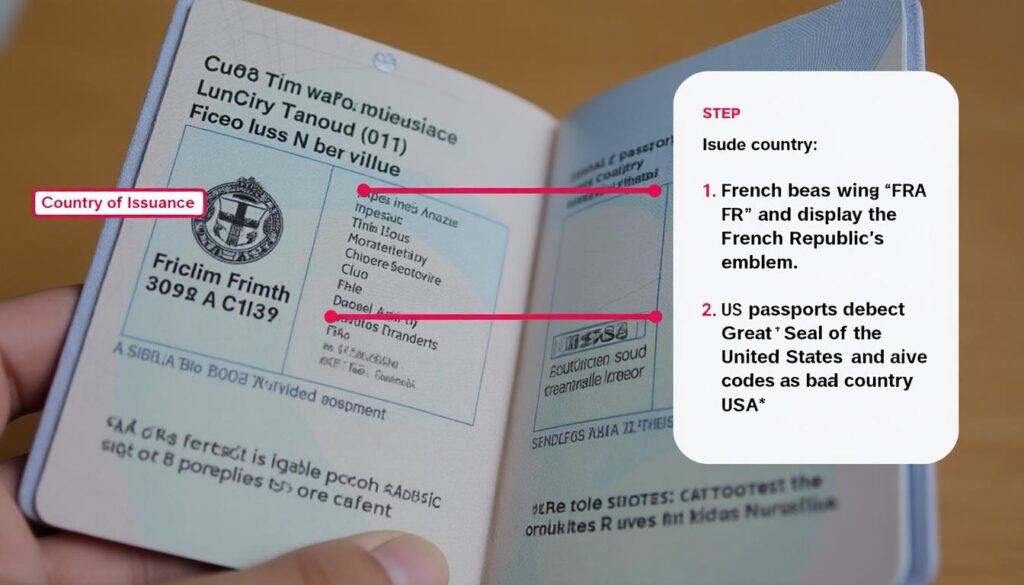

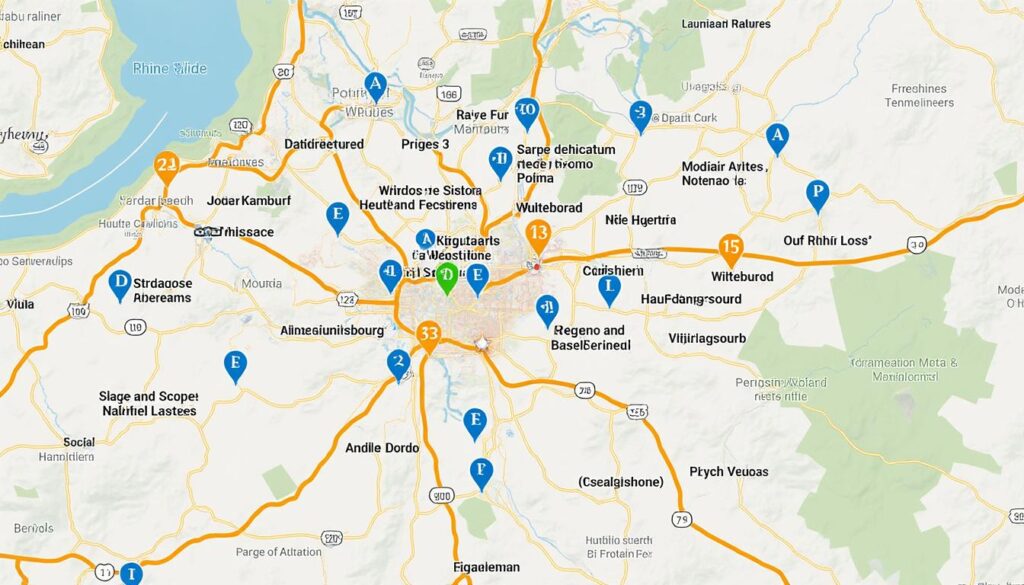

La découverte des Antilles françaises, également connues sous le nom de West Indies France, révèle un monde où la beauté naturelle et la richesse culturelle s’enlacent pour offrir une expérience de voyage inoubliable. Ces territoires d’outre-mer, nichés au cœur des Caraïbes, invitent les voyageurs à ...

Voir l'article